Twitter ekran görüntüleri / Unsplash, Yazar sağlanan

Twitter hafta sonu boyunca, ABD Demokrat başkan adayı Joe Biden'ın bir kalabalığa hitap ederken hangi durumda olduğunu unuttuğunu gösteren bir videoyu manipüle ederek "etiketlendi".

Biden'ın "merhaba Minnesota" selamlaması, "Tampa, Florida" ve "FL'den 30330'a Metin" şeklinde okunan önemli tabelalarla tezat oluşturuyordu.

Associated Press'in doğruluk kontrolü onaylı işaretler dijital olarak eklendi ve orijinal görüntüler gerçekten de bir Minnesota mitingine aitti. Ancak yanıltıcı video kaldırıldığında zaten bir milyondan fazla görüntülendi. Guardian raporlar.

Biden'in hangi durumda olduğunu unuttuğunu iddia eden YANLIŞ bir video, son 1 saat içinde Twitter'da 24 milyondan fazla kez görüntülendi.

- Donie O'Sullivan (@donie) 1 Kasım 2020

Videoda Biden "Merhaba Minnesota" diyor.

Olay gerçekten de MN'de gerçekleşti - sahnedeki işaretler MN'yi okudu

Ama yanlış video Florida'yı okumak için işaretler düzenledi pic.twitter.com/LdHQVaky8v

Sosyal medyayı kullanırsanız, muhtemelen şunlardan bazılarını görürsünüz (ve iletirsiniz) 3.2 milyar görüntüler ve 720,000 saat videonun günlük paylaşılan. Bu kadar çok içerikle karşı karşıya kaldığımızda, neyin gerçek neyin olmadığını nasıl bilebiliriz?

Çözümün bir parçası içerik doğrulama araçlarının artan kullanımı olsa da, hepimizin dijital medya okuryazarlığımızı artırmamız eşit derecede önemlidir. Nihayetinde, en iyi savunma hatlarından biri - ve kontrol edebileceğiniz tek kişi - sensin.

Görmek her zaman inanmak olmamalı

Yanlış bilgi (yanlışlıkla yanlış içerik paylaştığınızda) ve dezenformasyon (kasıtlı olarak paylaştığınızda) herhangi bir ortamda sivil kurumlara olan güveni aşındırmak haber kuruluşları, koalisyonlar ve toplumsal hareketler gibi. Bununla birlikte, sahte fotoğraflar ve videolar genellikle en etkili olanlardır.

Siyasi bir çıkarı olanlar için, sahte görüntüler oluşturmak, paylaşmak ve / veya düzenlemek, izleyicilerin dikkatini dağıtabilir, kafalarını karıştırabilir ve yönlendirerek uyumsuzluk ve belirsizlik ekebilir (özellikle zaten kutuplaşmış ortamlarda). Posterler ve platformlar, sahte, sansasyonel içeriklerin paylaşımından da para kazanabilir.

Bir tek 11-25% Uluslararası Gazeteciler Merkezi'ne göre dünya çapında gazetecilerden% XNUMX'ü sosyal medya içerik doğrulama araçlarını kullanıyor.

Düzeltilmiş bir görüntüyü görebilir misin?

Martin Luther King Jr.'ın bu fotoğrafını düşünün.

Dr. Martin Luther King Jr. Orta parmağı verirken #DopeTarihiResimler pic.twitter.com/5W38DRaLHr

- Dope Historic Pics (@dopehistoricpic) 20 Aralık 2013

Bu değiştirilmiş görüntü Arka planın bir bölümünü King Jr'ın parmağı üzerinde klonlar, bu yüzden kamerayı ters çeviriyor gibi görünüyor. Tarihinde gerçek olarak paylaşıldı Twitter, Reddit ve beyaz üstünlükçü web siteleri.

içinde orijinal King, ABD Senatosunun sivil haklar tasarısını kabul ettiğini öğrendikten sonra 1964 tarihli fotoğrafta "Zafere V" işaretini parlattı.

"Barışı sevenler, savaşı sevenler kadar etkili bir şekilde örgütlenmeyi öğrenmelidir."

- Willie Rezervi (@WilliesReserve) Ocak 21, 2019

Dr Martin Luther King Jr

??

Bu fotoğraf 19 Haziran 1964'te çekildi ve Dr. King'in medeni haklar tasarısının senatodan geçtiğini duyduktan sonra barış işareti verdiğini gösteriyor. @snopes pic.twitter.com/LXHmwMYZS5

Öğe eklemenin veya kaldırmanın ötesinde, görüntülerin bir araya getirildiği tam bir fotoğraf işleme kategorisi vardır.

Bu yılın başlarında, bir Fotoğraf silahlı bir adamın fotoğrafını çekmiş Fox Haber, düzenlemeleri açıklamadan adamı diğer sahnelerin üzerine yerleştiren Seattle Times rapor.

Fox News tarafından yayınlanan üç ayrı fotoğrafa fotoşoplanmış bu adam mı? pic.twitter.com/fAXpIKu77a

— Zander Yates ??????? ???? ?????????? (@ZanderYates) Haziran 13, 2020

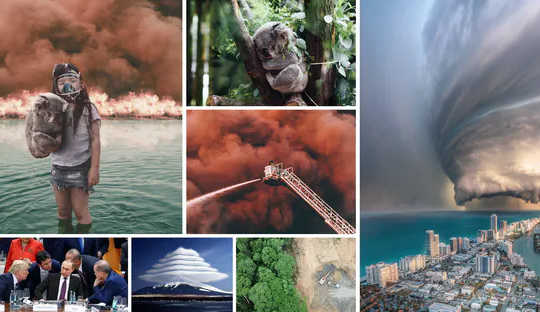

Benzer şekilde, görüntü Ocak ayında Avustralya'nın Kara Yaz orman yangınları sırasında sosyal medyada binlerce kez paylaşıldı. AFP'nin doğruluk kontrolü onaylı gerçek değildir ve aslında aşağıdakilerin birleşimidir: birkaç ayrı fotoğraflar.

Görüntü, Greta'nın çığlıklarından daha güçlü. Sessiz bir kız bir koala tutuyor. Bir sığınak buldukları okyanusun sularından doğrudan size bakıyor. Solunum maskesi takıyor. Arkalarında bir ateş duvarı var. Fotoğrafçının adını bilmiyorum #Australia pic.twitter.com/CrTX3lltdh

- EVC Müzik (@EVCMusicUK) Ocak 6, 2020

Tamamen ve kısmen sentetik içerik

Çevrimiçi olarak, sofistike "deepfake”(Genellikle ünlü) insanları hiç yapmadıkları şeyleri söyleyen veya yapan videolar. Daha az gelişmiş sürümler uygulamalar kullanılarak oluşturulabilir Zao gibi ve Yeniden düzenleme.

{vembed Y=yaq4sWFvnAY}

Massachusetts Institute of Technology'den bir ekip, ABD Başkanı Richard Nixon'un 1969 ayına inişin başarısız olması durumunda hazırlanmış bir konuşmadan satırları okuduğunu gösteren bu sahte videoyu oluşturdu. (Youtube)

Veya fotoğrafınızı bir profil resmi olarak kullanmak istemiyorsanız, varsayılan olarak birkaç web siteleri Yüzbinlerce yapay zeka tarafından oluşturulmuş, fotoğraf gerçekliğinde insan görüntüleri sunuyor.

Bu insanlar yok, sadece yapay zeka tarafından üretilen görüntüler. Oluşturulan Fotoğraflar, CC BY

Piksel değerlerini ve (o kadar değil) basit kırpmayı düzenleme

Kırpma, bir fotoğrafın bağlamını da büyük ölçüde değiştirebilir.

Bunu 2017 yılında, bir ABD hükümet çalışanı, kalabalığı daha büyük göstermek için Donald Trump'ın göreve başlama töreninin resmi resimlerini düzenlediğinde gördük. Guardian. Personel, Trump için bir dizi resim için "kalabalığın bittiği yer" boş alanı kırptı.

2009'da eski ABD Başkanı Barack Obama'nın (solda) ve Başkan Donald Trump'ın 2017'de (sağda) açılış törenlerinde kalabalığın görüntüleri. AP

2009'da eski ABD Başkanı Barack Obama'nın (solda) ve Başkan Donald Trump'ın 2017'de (sağda) açılış törenlerinde kalabalığın görüntüleri. AP

Peki ya sadece renk, doygunluk veya kontrast gibi piksel değerlerini değiştiren düzenlemeler?

Tarihsel bir örnek, bunun sonuçlarını göstermektedir. 1994'te Time dergisi kapak OJ Simpson, Simpson'ı önemli ölçüde "kararttı". polis fotoğrafı. Bu, zaten ırksal gerilimle boğuşan bir vakaya yakıt ekledi. cevap:

Zaman ya da sanatçı tarafından hiçbir ırksal ima kast edilmedi.

1994'teki bu tartışmayı düşünüyor olabilirsiniz. Time dergisi, OJ Simpson'ın sabıka fotoğrafını karartmak için bir yığın sorunla karşılaştı ve sorunu geri çekmek zorunda kaldı. Muhtemelen böyle bir şeyin en ünlü örneğidir. Ve evet, kendimle çıkıyorum, biliyorum. pic.twitter.com/7U7Yw7XZGU

- Pilar Pedraza TV (@PilarPedrazaTV) 2 Kasım 2020

Dijital sahtekarlığı çürütmek için araçlar

Görsel yanlış / dezenformasyonla kandırılmak istemeyen bizler için, mevcut araçlar vardır - her biri kendi sınırlamalarıyla birlikte gelse de kâğıt).

görünmez dijital filigran basma çözüm olarak önerilmiştir. Ancak, yaygın değildir ve hem içerik yayıncılarından hem de dağıtımcılardan satın almayı gerektirir.

Tersine görsel arama (ör. Google'ın) genellikle ücretsizdir ve görüntülerin daha önceki, potansiyel olarak daha gerçek kopyalarını çevrimiçi olarak tanımlamak için yardımcı olabilir. Bununla birlikte, kusursuz değildir çünkü:

- halihazırda çevrimiçi olan medyanın düzenlenmemiş kopyalarına dayanır

- aramıyor tüm ağ

- her zaman yayın zamanına göre filtrelemeye izin vermez. Aşağıdakiler gibi bazı tersine görsel arama hizmetleri TinEye bu işlevi destekler, ancak Google'ın desteklemez.

- yalnızca tam eşleşmeleri veya yakın eşleşmeleri döndürür, bu nedenle kapsamlı değildir. Örneğin, bir görüntüyü düzenlemek ve ardından yönünü ters çevirmek, Google'ı bunun tamamen farklı bir görüntü olarak düşünmesine neden olabilir.

En güvenilir araçlar karmaşıktır

Bu arada, görsel yanlış / dezenformasyon için manuel adli tespit yöntemleri çoğunlukla çıplak gözle görülebilen düzenlemelere odaklanır veya her görüntüde bulunmayan özellikleri (gölgeler gibi) incelemeye dayanır. Ayrıca zaman alıcı, pahalıdır ve özel uzmanlığa ihtiyaç duyarlar.

Yine de, büyüyen bir "veri havuzuna sahip olan Snopes.com" gibi siteleri ziyaret ederek bu alandaki çalışmalara erişebilirsiniz.sahtecilik anlayışının sonucu olarak, buzdolabında iki üç günden fazla durmayan küçük şişeler elinizin altında bulunur.

Bilgisayarla görü ve makine öğrenimi ayrıca görüntüler için nispeten gelişmiş algılama yetenekleri sunar ve videolar. Ancak onların da çalışması ve anlaşılması için teknik uzmanlığa ihtiyaçları vardır.

Dahası, onları iyileştirmek büyük hacimlerde "eğitim verisi" kullanmayı içerir, ancak bunun için kullanılan görüntü havuzları genellikle haberlerde görülen gerçek dünya görüntülerini içermez.

REVEAL projesininki gibi bir görüntü doğrulama aracı kullanıyorsanız görüntü doğrulama asistanı, sonuçları yorumlamak için bir uzmana ihtiyacınız olabilir.

Bununla birlikte, iyi haber şu ki, yukarıdaki araçlardan herhangi birine geçmeden önce, sosyal medyadaki bir fotoğrafın veya videonun sahte olup olmadığını anlamak için kendinize sorabileceğiniz bazı basit sorular var. Düşünün:

- başlangıçta sosyal medya için mi yapıldı?

- ne kadar yaygın ve ne kadar süreyle dolaşıma sokuldu?

- ne gibi tepkiler aldı?

- hedeflenen izleyiciler kimlerdi?

Çoğu zaman, cevaplardan çıkarılan mantıksal sonuçlar, orijinal olmayan görselleri ayıklamak için yeterli olacaktır. Manchester Metropolitan Üniversitesi uzmanları tarafından bir araya getirilen soruların tam listesine erişebilirsiniz, okuyun.![]()

Yazarlar Hakkında

TJ Thomson, Görsel İletişim ve Medya Kıdemli Öğretim Üyesi, Queensland University of Technology; Daniel Angus, Dijital İletişimde Doçent, Queensland University of Technologyve Paula Dootson, Kıdemli Öğretim Görevlisi, Queensland University of Technology

Bu makale şu adresten yeniden yayınlandı: Konuşma Creative Commons lisansı altında. Okumak Orijinal makale.