Yapay zeka destekli dedektörler, yapay zeka tarafından oluşturulan sahte videoları tespit etmek için en iyi araçlardır. Getty Images üzerinden Washington Post

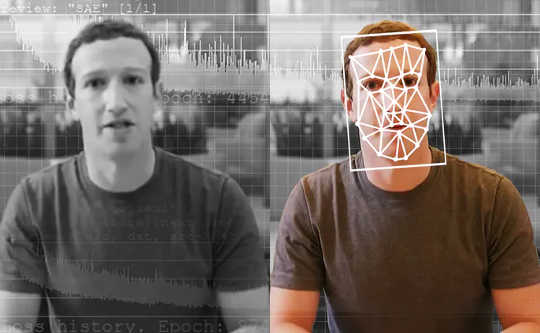

Araştırmacı bir gazeteci, anonim bir ihbarcıdan bir video alır. Yasadışı faaliyette bulunduğunu kabul eden bir başkan adayını gösteriyor. Ama bu video gerçek mi? Öyleyse, büyük bir haber olur - bir ömür boyu sürecek bir haber - ve yaklaşan seçimleri tamamen tersine çevirebilir. Ancak gazeteci videoyu özel bir araçla çalıştırır ve bu ona videonun göründüğü gibi olmadığını söyler. Aslında bu bir "deepfake, "İle yapay zeka kullanılarak yapılmış bir video" derin öğrenme.

Dünyanın her yerindeki gazeteciler yakında bunun gibi bir araç kullanabilir. Birkaç yıl içinde, bunun gibi bir araç herkes tarafından sosyal medya beslemelerindeki sahte içeriği kökten çıkarmak için bile kullanılabilir.

As Araştırmacılar derin sahte algılama üzerinde çalışan ve gazeteciler için bir araç geliştirdiğimizde, bu araçlar için bir gelecek görüyoruz. Yine de tüm sorunlarımızı çözmeyecekler ve dezenformasyona karşı daha kapsamlı mücadelede cephaneliğin sadece bir parçası olacaklar.

Deepfake ile ilgili sorun

Çoğu insan gördüğünüz her şeye inanamayacağınızı bilir. Son birkaç on yılda, bilgili haber tüketicileri, fotoğraf düzenleme yazılımı ile manipüle edilmiş görüntüleri görmeye alıştı. Videolar ise başka bir hikaye. Hollywood yönetmenleri gerçekçi bir sahne oluşturmak için özel efektlere milyonlarca dolar harcayabilirler. Ancak derin sahte kullanmak, birkaç bin dolarlık bilgisayar ekipmanı ve harcayacak birkaç hafta olan amatörler, bir şeyi neredeyse gerçeğe yakın hale getirebilir.

Deepfake, insanları hiç içinde olmadıkları film sahnelerine koymayı mümkün kılıyor - Tom Cruise'un Iron Man oynadığını düşünüyorum - eğlenceli videolar için yapar. Ne yazık ki, aynı zamanda oluşturmayı da mümkün kılar izinsiz pornografi tasvir edilen insanların. Şimdiye kadar, bu insanlar, neredeyse tüm kadınlar, deepfake teknolojisi kötüye kullanıldığında en büyük kurbanlar oluyor.

Deepfake'ler, siyasi liderlerin asla söylemedikleri şeyleri söyleyen videolarını oluşturmak için de kullanılabilir. Belçika Sosyalist Partisi, düşük kaliteli, sahte olmayan ancak yine de sahte bir video yayınladı. Başkan Trump, Belçika'ya hakaret ediyor, yüksek kaliteli deepfake'lerin potansiyel risklerini göstermeye yetecek kadar tepki aldı.

{vembed Y=poSd2CyDpyA}

California Üniversitesi, Berkeley'den Hany Farid, deepfake'lerin nasıl yapıldığını açıklıyor.

belki en korkutucu, oluşturmak için kullanılabilirler gerçek videoların içeriği hakkında şüphe duymak, derin sahte olabileceklerini öne sürerek.

Bu riskler göz önüne alındığında, derin sahteleri tespit edebilmek ve bunları açıkça etiketleyebilmek son derece değerli olacaktır. Bu, sahte videoların halkı kandırmamasını ve gerçek videoların gerçek gibi alınabilmesini sağlar.

Sahte sahte

Bir araştırma alanı olarak derin sahte tespiti biraz daha başladı üç yıl önce. İlk çalışmalar, videolardaki gözle görülür sorunları tespit etmeye odaklandı. yanıp sönmeyen deepfake'ler. Ancak zamanla sahte daha iyi hale geldi gerçek videoları taklit etme ve hem insanlar hem de algılama araçları için fark edilmesi zorlaşır.

Derin sahte tespit araştırmasının iki ana kategorisi vardır. İlki içerir insanların davranışlarına bakmak videolarda. Başkan Obama gibi ünlü birinin çok sayıda videosuna sahip olduğunuzu varsayalım. Yapay zeka, el hareketlerinden konuşmadaki duraklamalarına kadar onun kalıplarını öğrenmek için bu videoyu kullanabilir. O zaman olabilir onun sahtekarlığını izle ve bu modellerle nerede uyuşmadığına dikkat edin. Bu yaklaşım, video kalitesinin kendisi esasen mükemmel olsa bile muhtemelen çalışma avantajına sahiptir.

{vembed Y=gsv1OsCEad0}

SRI International'dan Aaron Lawson, derin sahteleri tespit etmeye yönelik bir yaklaşımı anlatıyor.

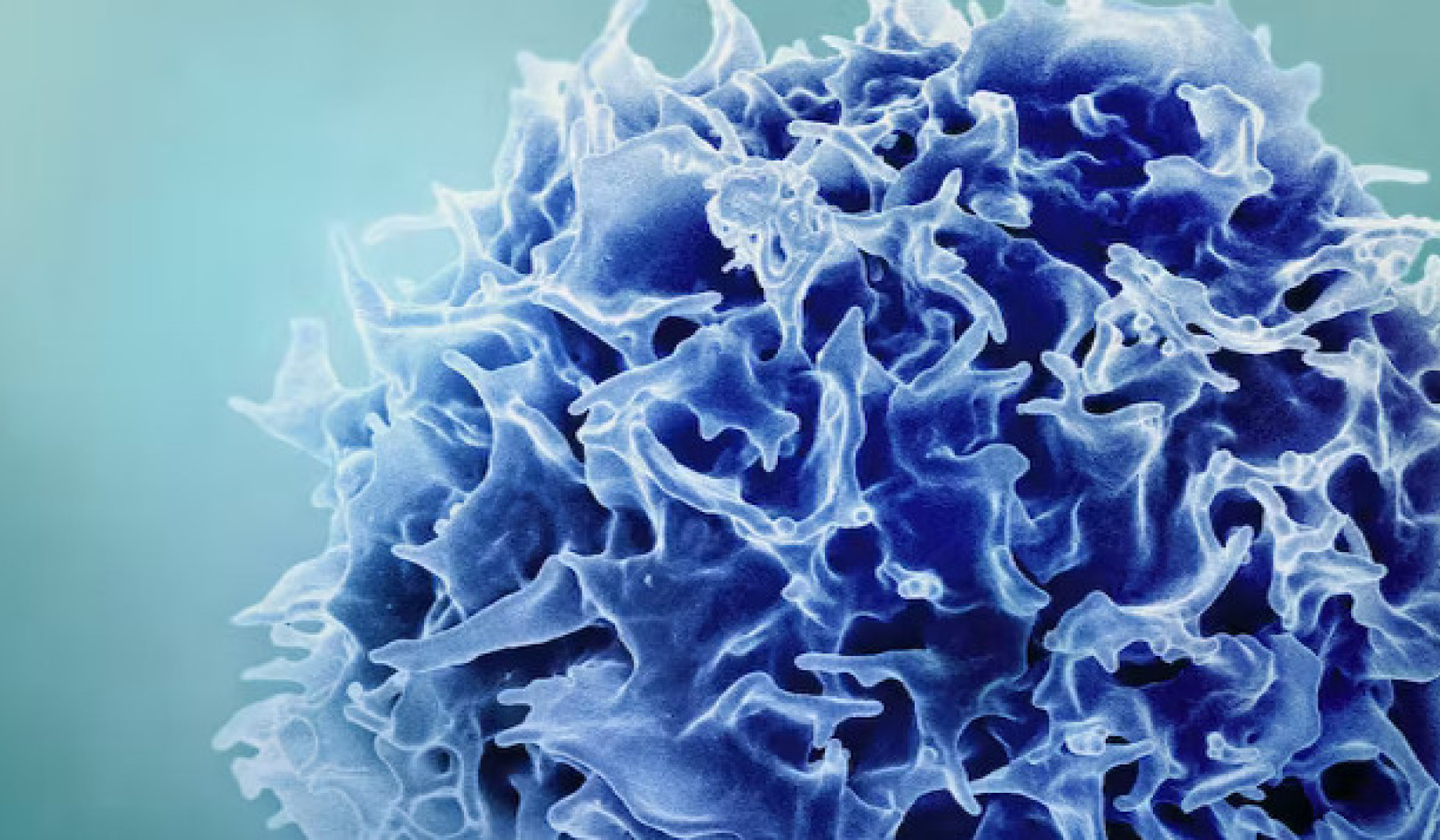

Diğer araştırmacılar, ekibimiz dahilodaklandı farklılıkları o tüm deepfake'ler var gerçek videolarla karşılaştırıldığında. Deepfake videoları genellikle videolar oluşturmak için ayrı ayrı oluşturulan karelerin birleştirilmesiyle oluşturulur. Ekibimizin yöntemleri, bunu hesaba katarak, bir videonun tek tek karelerindeki yüzlerden temel verileri çıkarır ve ardından bunları eşzamanlı kare kümeleri aracılığıyla izler. Bu, bir çerçeveden diğerine bilgi akışındaki tutarsızlıkları tespit etmemizi sağlar. Sahte ses algılama sistemimiz için de benzer bir yaklaşım kullanıyoruz.

Bu ince ayrıntıları insanların görmesi zor, ancak derin sahtekarlıkların ne kadar henüz mükemmel. Bunun gibi dedektörler, sadece birkaç dünya lideri için değil, herhangi bir kişi için çalışabilir. Sonunda, her iki tür derin sahte dedektörüne de ihtiyaç duyulabilir.

En son tespit sistemleri, araçları değerlendirmek için özel olarak toplanan videolarda çok iyi performans gösteriyor. Ne yazık ki, en iyi modeller bile çevrimiçi bulunan videolarda yetersiz. Bu araçları daha sağlam ve kullanışlı olacak şekilde geliştirmek bir sonraki adımdır.

Derin sahte dedektörleri kimler kullanmalıdır?

İdeal olarak, bir derin sahte doğrulama aracı herkesin kullanımına açık olmalıdır. Bununla birlikte, bu teknoloji geliştirmenin ilk aşamalarında. Araştırmacıların araçları geniş bir şekilde yayınlamadan önce geliştirmeleri ve bilgisayar korsanlarına karşı korumaları gerekir.

Aynı zamanda, derin sahte yapma araçları, halkı kandırmak isteyen herkes tarafından kullanılabilir. Kenarda oturmak bir seçenek değil. Ekibimiz için doğru denge, gazetecilerle çalışmaktı çünkü yanlış bilgilerin yayılmasına karşı ilk savunma hattı onlar.

Hikayeleri yayınlamadan önce, gazetecilerin bilgileri doğrulaması gerekir. Kaynakları kontrol etmek ve temel gerçekleri doğrulamak için birden fazla kişiyi almak gibi denenmiş ve doğru yöntemleri zaten var. Bu nedenle, aracı ellerine vererek onlara daha fazla bilgi veriyoruz ve hata yapabileceği düşünüldüğünde teknolojiye tek başına güvenmeyeceklerini biliyoruz.

Dedektörler silahlanma yarışını kazanabilir mi?

Takımları görmek cesaret verici. Facebook ve Microsoft Deepfake'leri anlamak ve tespit etmek için teknolojiye yatırım yapmak. Deepfake teknolojisindeki ilerlemelerin hızına ayak uydurmak için bu alanın daha fazla araştırmaya ihtiyacı var.

Gazeteciler ve sosyal medya platformlarının da, tespit edildiklerinde insanları derin sahtekarlıklar konusunda en iyi nasıl uyaracaklarını bulmaları gerekiyor. Araştırma gösterdi ki insanlar yalanı hatırlarama yalan olduğu gerçeği değil. Aynı şey sahte videolar için de geçerli olacak mı? Başlığa sadece "Deepfake" koymak, bazı dezenformasyon türlerine karşı koymak için yeterli olmayabilir.

Deepfake'ler burada kalacak. Yapay zeka daha güçlü hale geldikçe dezenformasyonu yönetmek ve halkı korumak her zamankinden daha zor olacak. Algılamanın sadece ilk adım olduğu, bu tehdidi üstlenen büyüyen bir araştırma topluluğunun parçasıyız.![]()

Yazarlar Hakkında

Bilgisayar ve Bilişim Bilimleri Doktora Öğrencisi John Sohrawardi, Rochester Teknoloji Enstitüsü ve Bilgisayar Güvenliği Profesörü Matthew Wright, Rochester Teknoloji Enstitüsü

Bu makale şu adresten yeniden yayınlandı: Konuşma Creative Commons lisansı altında. Okumak orijinal göre.